大语言模型

模型定义

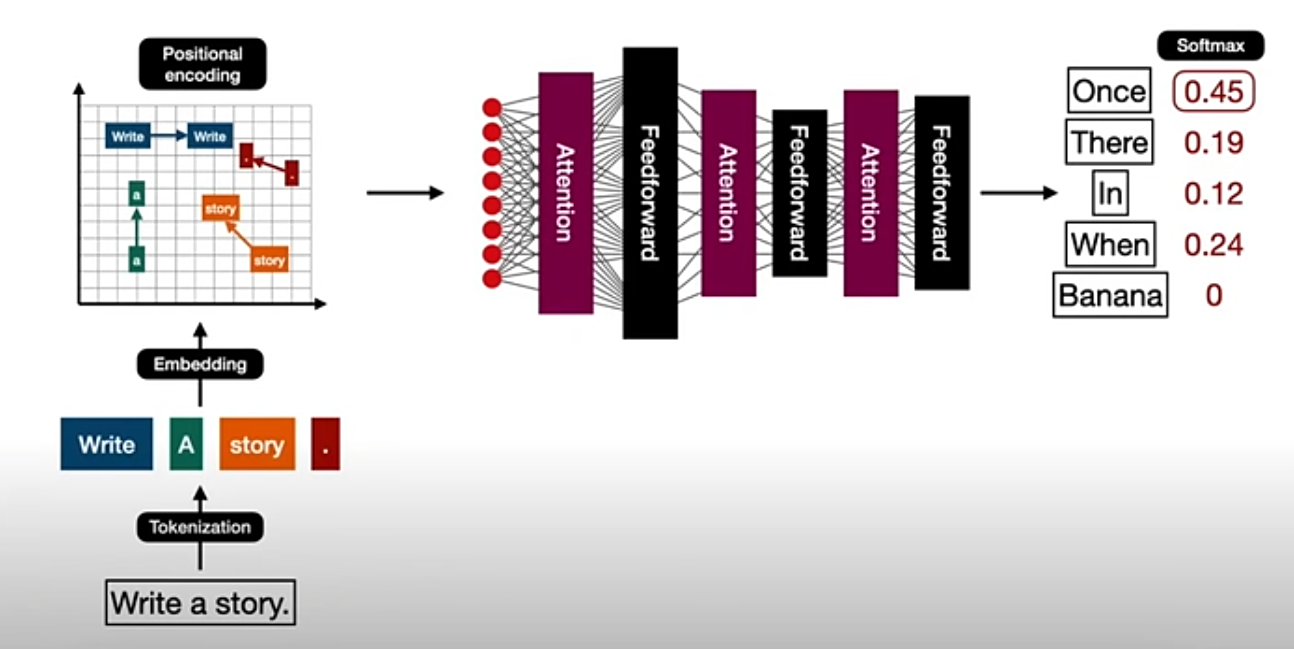

大型语言模型 (LLM) 是一种因其能够实现通用语言理解和生成而显著的语言模型。LLM通过在计算密集型的自监督和半监督训练过程中学习文本文档的统计关系来获得这些能力。LLM是遵循变换器架构的人工神经网络。

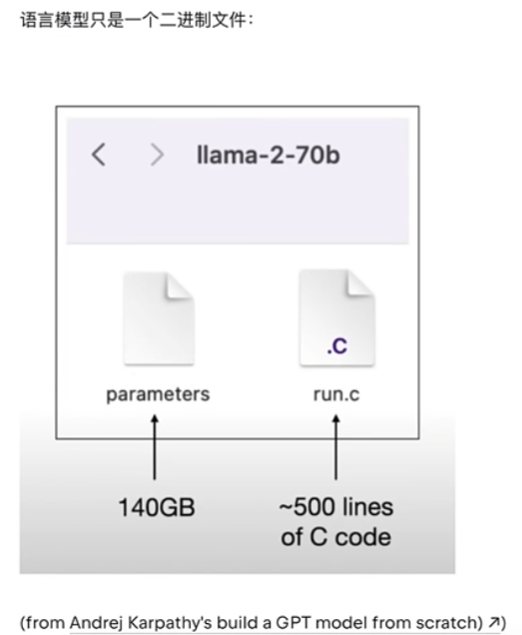

模型文件

moe结构

模型规模是提升模型性能的关键因素之一。在有限的计算资源预算下,用更少的训练步数训练一个更大的模型,往往比用更多的步数训练一个较小的模型效果更佳。

混合专家模型 (MoE) 的一个显著优势是它们能够在远少于稠密模型所需的计算资源下进行有效的预训练。这意味着在相同的计算预算条件下,你可以显著扩大模型或数据集的规模。特别是在预训练阶段,与稠密模型相比,混合专家模型通常能够更快地达到相同的质量水平。

Transformer结构

文章评论